La Inteligencia Artificial se convierte en una herramienta imprescindible en la sociedad actual. No ha venido a sustituirnos como ‘especie superior’ ni nada parecido

Por: Idoia Salazar

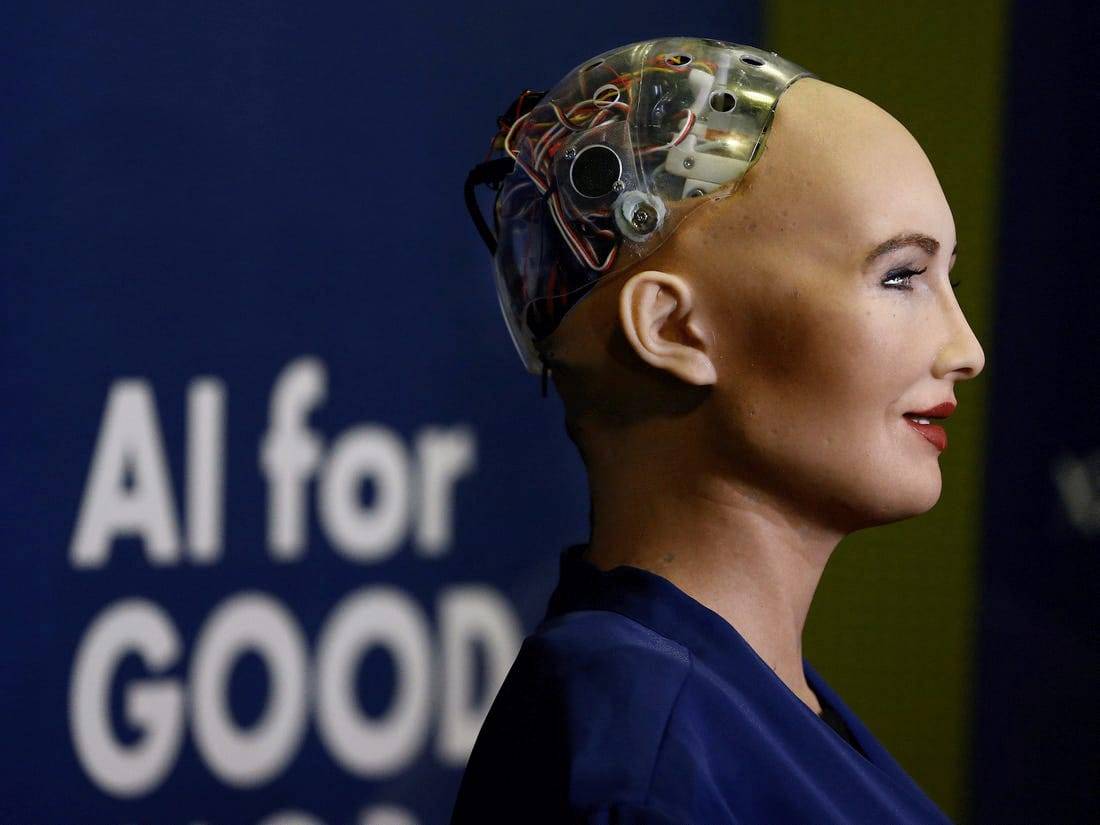

¿Robots con ética humana?. La Inteligencia Artificial es, sin duda, una tecnología disruptiva. Ya, en los inicios de su implementación real, está causando cierta conmoción en la sociedad motivada por las peculiaridades asociadas a ella.

Pero, la gran pregunta es, ¿por qué el desconcierto actual no ocurrió con otras innovaciones similares precedentes, tal es el caso de Internet o, en su momento, la máquina de vapor?.

En este último caso, durante la Revolución Industrial, cabe destacar que sí hubo un movimiento contrario: el ludismo, encabezado por artesanos ingleses que, en el siglo XIX, protestaron contra las máquinas que destruían y despersonalizaban el empleo. Sin embargo, esta resistencia al progreso motivada por los sinsabores que, sin duda, también pueden traer las innovaciones, fue superada por las ventajas que, también, indudablemente, trajeron las máquinas a nuestras vidas.

Hoy en día, el llamado ‘neoludismo’ persiste, asociado a aquellos que, sin ser violentos, ven en las nuevas tecnologías un impacto social claramente negativo y perjudicial.

Por supuesto, la IA no se queda al margen en este saco de herramientas -para algunos conflictivas- que están ayudando, de manera ineludible, a forjar nuestro futuro. Además, en esta ocasión, confluyen una serie de variantes que incrementan exponencialmente los argumentos a favor de la resistencia al cambio.

Le invitamos a leer: Crean piel humana viva para revestir a los robots

Las nuevas ‘máquinas’ parecen tener ciertas ‘cualidades’, que hasta ahora solo podíamos asociar a los seres humanos. Y, entonces, surge otra gran pregunta: si ahora las ‘máquinas’ también pueden hacer labores con ‘inteligencia’ -en lo que a la toma de decisiones se refiere- ¿qué nos queda a los humanos?

Normalmente llamamos ‘inteligencia’ a la capacidad para entender o comprender algo…también la habilidad para resolver problemas. A esta definición, normalmente solemos asociarle otra cuestión relativa al contexto donde se toma la decisión.

Percibimos que alguien ha tomado una ‘decisión inteligente’, cuando la persona ha tenido en cuenta una serie de variantes contextuales -de muchas clases-, además del mero análisis de datos que procesa nuestro limitado cerebro.

Una de ellas es, sin duda, la ética. Los principios éticos universales, por un lado y, por el otro, los culturales -o geográficos, según se mire-. Y es aquí donde el ser humano encuentra una salida a su gran pregunta.

Los algoritmos de IA son capaces de analizar datos e, incluso, pueden llegar a conclusiones mejor fundamentadas -sobre los datos de los que ha dispuesto- que un humano. Pero, al menos por el momento, no son capaces de contextualizar su decisión, de aportar la ética necesaria para que dicha decisión sea válida para la sociedad.

Puede leer también: ¿Qué elementos tecnológicos puedes llevar a una excursión?

Por el momento no, es verdad. Sin embargo, es el momento de empezar a cuestionarnos si éstas son las preguntas que deberíamos hacernos en la actualidad o, más bien, centrar nuestros esfuerzos en acoger un razonamiento más lógico y práctico respecto a estas tecnologías de gran impacto.

Una IA que complete, no que sustituya

Si abrimos un poco el contexto histórico en el que nos encontramos, nos damos cuenta de que los sistemas de IA -que ya habían comenzado su andadura a mitad del siglo XX, vienen a cubrir una necesidad actual. Nosotros, los humanos, no somos capaces de procesar -con la eficiencia y rapidez de las máquinas- el gran volumen de datos -Big Data- que, de manera exponencial, crece a cada segundo que pasa.

Necesitamos de los algoritmos para ‘aumentar’ nuestra capacidad física de análisis y aprovechar así las grandes ventajas derivadas del manejo apropiado de estos datos: tratamientos médicos personalizados, previsiones basadas en patrones extraídos de los datos…, entre otras muchas. ¿Y la ética de la que hablábamos antes?.

La ética, por ahora y pensando en planteamiento práctico, la seguimos poniendo nosotros, los humanos. ¿Y por qué no? La IA no ha venido a sustituirnos como ‘especie superior’ ni nada que se le parezca. Es simplemente una tecnología que nos ayuda a mejorar nuestra calidad de vida, como nos ayudó la imprenta en su momento o la lavadora en el suyo.

Actualmente, suele ser un ingeniero el que se encarga de diseñar y desarrollar los algoritmos de IA. Por tanto, debe de ser esta persona -o su equipo- el que se encargue de supervisar -mediante otros algoritmos u ojos humanos- los datos de los que se alimenta ese sistema, para evitar posibles sesgos que puedan suponer un perjuicio para otra persona -raza, sexo, ideología…-, dentro o fuera de la empresa u organismo en cuestión, y siempre en función de la finalidad del mismo.

Por tanto, la decisión final sigue siendo nuestra, de los humanos, y no tienen por qué cambiar si no lo deseamos así.

Y, es que, estamos en un momento en la historia de la humanidad, respecto a la evolución de la tecnología, en la que la pregunta no es si podemos hacer una determinada cosa, sino, más bien, si debemos llevarla a cabo. La cuestión no es si llegará un momento en que los algoritmos de IA sean capaces de tomar decisiones autónomas en cuestiones relevantes para el ser humano, sino, si debemos dejar que esto pase.

Está en nuestras manos, las de los humanos, en este momento crucial de la historia. De nuestras decisiones ahora dependerá nuestro futuro apocalíptico o integrador.